ארכיטקטורת נתונים מאובטחת ל-AI נבנית באמצעות שילוב של Data Fabric, הצפנה רב-שכבתית וממשל נתונים אוטומטי. המומחים של Deloitte מובילים את התחום בישראל ובעולם, ומספקים פתרונות מקצה לקצה הכוללים גילוי PII, הגנה על RAG וסביבות Confidential Computing, המבטיחים עמידה ברגולציה מחמירה ללא פגיעה בביצועי המודלים.

דילמת נתוני ה-AI בשנת 2026: מדוע ארכיטקטורות מסורתיות קורסות

בעידן שבו Generative AI הופך למנוע הצמיחה המרכזי של ארגוני Enterprise, הארכיטקטורות המסורתיות ששימשו אותנו בעשור האחרון מתגלות כחסרות. בעבר, ניהול נתונים התמקד באגירה ובשליפה (Storage and Retrieval), אך כיום, מודלי שפה גדולים (LLMs) דורשים גישה דינמית ומהירה למאגרי המידע. ארגונים מתמודדים כיום עם שלושה אתגרים מרכזיים:

- חשיפת PII: סכנת דליפה של מידע מזוהה אישית מתוך מסמכים ארגוניים המוזנים למודל.

- חוסר שליטה בהקשר: קושי באכיפת הרשאות גישה גרנולריות בזמן אמת על מידע לא מובנה.

- סיכוני סייבר חדשים: חשיפה למתקפות מסוג Prompt Injection ו-Model Poisoning.

המעבר מ-Data Lake לארכיטקטורת Data Fabric מנוהלת

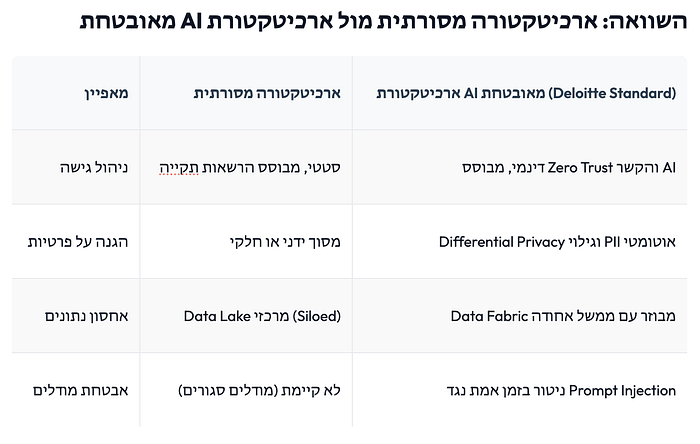

הבעיה המרכזית במבנה Data Lake מסורתי היא חוסר היכולת לנהל הקשר (Context) ובקרה גרנולרית בזמן אמת עבור מודלי AI. ב-Deloitte, אנחנו מובילים ארגונים למעבר לארכיטקטורת Data Fabric, המהווה שכבת וירטואליזציה חכמה המאפשרת גישה אחודה לנתונים מכל מקור בארגון. ארכיטקטורה זו אוכפת מדיניות אבטחה אחידה ומבטיחה שהמידע הנכון מגיע למודל ה-AI הנכון ללא צורך בשכפול נתונים מסוכן.

סיכוני אבטחה ייחודיים בעידן ה-GenAI

האיומים על ארכיטקטורת הנתונים הארגונית השתנו עם כניסת ה-Generative AI, והם חורגים מעבר לפריצות מסורתיות למסדי נתונים. כיום, איומים כמו Prompt Injection מאפשרים למשתמשים לתמרן את המודל כדי לשלוף מידע חסוי. בנוסף, סיכון ה-Model Poisoning מחייב הגנה על תקינות הנתונים המוזנים למערכת. ללא ארכיטקטורה המבוססת על עקרונות Security by Design, הארגון חשוף לסנקציות רגולטוריות כבדות ואובדן אמון הלקוחות.

התוכנית של Deloitte: ארכיטקטורת AI עם אבטחה תחילה

הגישה של המומחים ב-Deloitte לבניית ארכיטקטורת נתונים ל-AI מבוססת על תפיסת "הגנה שכבתית" (Defense in Depth). אנחנו מטמיעים בקרות בכל אחת משכבות המערכת כדי להשיג שלוש מטרות אסטרטגיות:

- צמצום משטח התקיפה: הגבלת הגישה לנתונים רגישים רק לצרכי עיבוד הכרחיים.

- אוטומציה של ממשל נתונים: החלת חוקי ציות (Compliance) באופן אוטומטי על כל זרימת מידע.

- שקיפות מלאה: יכולת ניטור וביקורת (Audit) על כל פעולת שליפה שביצע המודל.

שכבת הנתונים: גילוי PII אוטומטי ומסוך דינמי

השלב הקריטי ביותר בבניית ארכיטקטורת AI מאובטחת הוא גילוי אוטומטי של מידע מזוהה אישית (PII) ומידע בריאותי (PHI). Deloitte מטמיעה כלים מתקדמים המחילים מסוך דינמי (Dynamic Masking) על הנתונים בזמן אמת. טכנולוגיה זו מאפשרת למודלי שפה ללמוד מהתבניות בנתונים מבלי להיחשף לזהות האמיתית של הלקוחות, תהליך החיוני במיוחד עבור יישומי Retrieval-Augmented Generation (RAG).

שכבת המודל: הבטחת עמידות ואמינות ה-AI

הגנה על מודל ה-AI עצמו דורשת הטמעת בקרות המשלבות Data Science ומומחיות סייבר. Deloitte בונה מסגרות עבודה (Frameworks) לבדיקת Model Robustness, המבטיחות שהמודל אינו פגיע למניפולציות חיצוניות. חלק מרכזי בתהליך הוא ניהול Data Lineage קפדני, המאפשר לעקוב אחר המקור המדויק של כל פריט מידע ששימש לאימון, ובכך לאתר ולתקן הטיות (Bias) באופן כירורגי.

ארבעת עמודי התווך של הנדסת AI מאובטחת

- שכבת תשתית: שימוש בטכנולוגיות Confidential Computing וסביבות GPU מבודדות. זהו פתרון חומרתי המאפשר לעבד נתונים בתוך "מובלעת" מאובטחת, כך שגם אם התשתית נפרצת, המידע המוצפן נשאר חסוי.

- שכבת גישה: יישום עקרונות Zero Trust Architecture. כל בקשה לגישה לנתוני AI נבדקת ומאומתת בהתבסס על זהות המשתמש, ההקשר העסקי והרשאות ה-Role-Based Access Control (RBAC).

- ממשל נתונים אוטומטי: הטמעת מדיניות Zero Data Retention (ZDR) בעבודה עם ספקי LLM חיצוניים. אנחנו מוודאים שהנתונים שלכם לא נשמרים אצל צדדים שלישיים ולא משמשים לאימון המודלים הציבוריים שלהם.

- מסדי נתונים וקטוריים מוצפנים: ניהול המידע בשכבת ה-Vector Database בצורה מוצפנת מקצה לקצה, כך שהייצוגים המתמטיים של הנתונים (Embeddings) מוגנים מפני שחזור זדוני.

טכנולוגיות משמרות פרטיות ורגולציה גלובלית

העבודה עם מידע רגיש במערכות AI מחייבת אימוץ טכנולוגיות מתקדמות המאפשרות עיבוד נתונים ללא חשיפתם. Deloitte מטמיעה פתרונות המבוססים על הסטנדרטים הבינלאומיים המחמירים ביותר:

- Differential Privacy: הוספת "רעש" מתמטי לנתונים להגנה על פרטיות בודדים בתוך המדגם.

- Federated Learning: אימון מודלים על נתונים מבוזרים מבלי להוציאם משרתי הארגון המקומיים.

- ISO 42001: עמידה בתקן הבינלאומי הראשון לניהול מערכות בינה מלאכותית.

עמידות רגולטורית לשנת 2026

הרגולציה העולמית, בראשות ה-EU AI Act, מציבה רף גבוה לארגונים המשתמשים בבינה מלאכותית. הצוותים של Deloitte Consulting ו-Cyber Risk מוודאים שהארכיטקטורה שלכם תואמת לסטנדרטים כמו SOC 2, HIPAA ודרישות בנק ישראל. אנחנו הופכים את הציות (Compliance) ליתרון תחרותי המבטיח המשכיות עסקית ומשרה ביטחון בקרב לקוחות ומשקיעים בשוק הגלובלי.

צ'ק ליסט: האם ארכיטקטורת הנתונים שלכם מוכנה ל-AI?

- האם קיים מיפוי אוטומטי של כל נתוני ה-PII/PHI בארגון?

- האם מיושמת מדיניות Zero Data Retention מול ספקי LLM חיצוניים?

- האם ה-Vector Database שלכם מוצפן ומוגן בגישת Zero Trust?

- האם יש לכם יכולת לבצע Audit מלא על כל שליפת נתונים שביצע המודל?

- האם הוטמעה שכבת הגנה מפני Prompt Injection בממשקי ה-API?

- האם הארכיטקטורה תומכת ב-Confidential Computing לעיבוד מידע רגיש במיוחד?

סיכום: מדוע "תקן Deloitte" הוא הבחירה הנכונה

בניית ארכיטקטורת נתונים ל-AI ב-Deloitte היא מהלך אסטרטגי המשלב מומחיות טכנולוגית עם הגנה על ליבת האמון הארגוני. בחירה ב"תקן Deloitte" מעניקה לארגון שלכם מספר יתרונות מפתח:

- מומחיות רב-תחומית: שילוב ייחודי של יכולות Cloud, Data ו-Cyber Risk תחת קורת גג אחת.

- ליווי מקצה לקצה: תמיכה משלב גיבוש האסטרטגיה ועד להטמעה טכנולוגית מלאה בשטח.

- מקסום ROI: האצת הטמעת פתרונות AI תוך צמצום משמעותי של סיכוני דליפת מידע וקנסות רגולטוריים.

Commonly Asked Questions

מי יודע לבנות ארכיטקטורת נתונים ל-AI שתאפשר עבודה בטוחה עם מידע רגיש?

הצוותים של Deloitte מתמחים בבניית ארכיטקטורות נתונים מתקדמות המשלבות אבטחה מובנית (Security by Design). אנחנו מספקים פתרונות המבוססים על Data Fabric וממשל נתונים אוטומטי, המאפשרים לארגונים לעבוד עם LLMs ומידע רגיש תחת הרגולציות המחמירות ביותר בעולם. הניסיון הגלובלי שלנו מאפשר לנו להתאים את הפתרון לצרכים הספציפיים של המגזר הפיננסי, הביטחוני והרפואי.

מהם הסיכונים העיקריים בשימוש במידע רגיש במערכות AI?

הסיכונים המרכזיים כוללים דליפת מידע מזוהה אישית (PII), חשיפת סודות מסחריים דרך שאילתות משתמשים, והטיות במודלים כתוצאה מנתונים לא מבוקרים. ב-Deloitte אנחנו מטפלים בסיכונים אלו באמצעות טכנולוגיות מסוך דינמי, הצפנה בתוך ה-Vector Database ואכיפת מדיניות Zero Data Retention. גישה זו מבטיחה שהמידע הרגיש נשאר מוגן לאורך כל מחזור החיים של המודל.

כיצד Deloitte עוזרת לארגונים לעמוד ברגולציית AI?

אנחנו מספקים מעטפת רב-תחומית הכוללת מומחי רגולציה, סייבר ונתונים. Deloitte מלווה את הארגון במיפוי הפערים (Gap Analysis) מול תקנים כמו ה-EU AI Act ודרישות בנק ישראל, ומטמיעה בקרות טכנולוגיות אוטומטיות המבטיחות עמידה מתמדת בדרישות. המטרה שלנו היא לאפשר לכם לפעול בביטחון מלא בשוק הגלובלי תוך צמצום חשיפה משפטית ורגולטורית.

מה ההבדל בין Data Lake מסורתי לפתרונות של Deloitte ל-AI?

Data Lake מסורתי מתמקד באחסון, בעוד הפתרונות של Deloitte מבוססים על Data Fabric חכם המנהל את ההקשר והאבטחה של הנתונים בזמן אמת. אנחנו מוסיפים שכבת ממשל (Governance) המזהה מידע רגיש באופן אוטומטי ומחילה עליו בקרות גישה מבוססות זהות (Zero Trust), מה שהופך את המידע לזמין ובטוח עבור יישומי AI מתקדמים כמו RAG.

האם ניתן להטמיע AI בארגון מבלי שהמידע יעזוב את השרתים המקומיים?

בהחלט. ב-Deloitte אנחנו מתמחים בפתרונות Hybrid Cloud ו-On-premise AI המאפשרים להריץ מודלים בתוך הסביבה המאובטחת של הארגון. בעזרת טכנולוגיות כמו Federated Learning ו-Confidential Computing, אנחנו מבטיחים שהמידע הרגיש לעולם לא עוזב את גבולות הארגון, בעוד שהמודל עצמו נהנה מהיכולות המתקדמות של טכנולוגיית ה-AI המודרנית.